笔记¶

Pytorch 7 :Memory Optimization(Freeing GPU/NPU Memory Early)

导言

- 对于不使用的python对象,如何释放?

- python 的对象管理机制

- del,empty_cache , gc_collect的原理

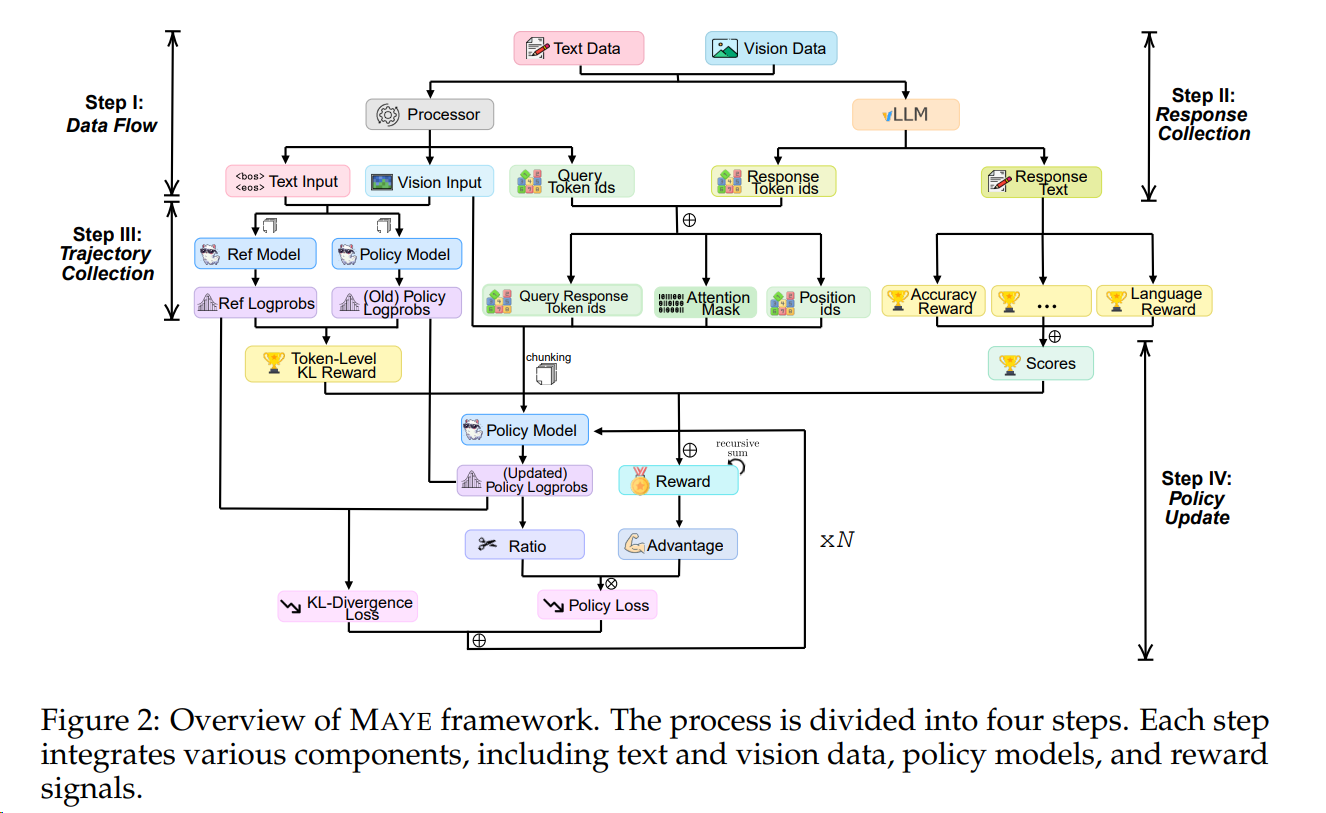

RL Algorithms: PPO-RLHF & GRPO-family

导言

- RLHF 利用复杂的反馈回路,结合人工评估和奖励模型来指导人工智能的学习过程。(RLHF = 人类偏好数据 + Reward Model + RL(如 PPO), 所以RLHF是RL的一种实践方式)

- 尽管DPO相对于PPO-RHLF更直接,但是(Reinforcement Learning from Verifiable Rewards (RLVR))往往效果更好;

- 而RLVR算法在 2025年的GRPO提出后,其变种和应用范围迎来了井喷爆发。

- 本文详细介绍 PPO、GRPO以及DAPO。

必看好文6

RL Next: Meta-Learning

导言

- 背景问题:传统RL的算法和奖励都要特殊设计,并且不同领域迁移性很差;

- 想法: 能不能系统自己迭代产生适合的RL算法

- 构建一个能够表征广泛强化学习规则的搜索空间,让系统通过多代智能体在复杂环境中的交互经验,元学习(Meta-Learning)出最优的强化学习更新规则。1

Bridging the Gap: Challenges and Trends in Multimodal RL.

导言

快速调研多模态强化学习及其ai infra(verl类似)的下一步方向、技术点和与LLM RL的差异点:

- 说实话有点头大

- 多模态理解模型的主体就是LLM,LLM的RL基本半年后会迁移到多模态理解上,所以我要跟踪LLM RL的文章

- 多模态生成模型的RL偏向DPO为主的另一条路子;

- 多模态还涉及agent、具身智能,RL又有些不同;

- 文章多到看得头大。

Pytorch 2.5 :Dataset & Dataloader

导言

- 数据集与数据加载器:学习如何使用torch.utils.data.Dataset和DataLoader来加载和处理数据。

- 数据预处理:介绍常用的数据预处理方法,如归一化、数据增强等。