2023¶

Cuda Driver Runtime

导言

Divide the bulky and outdated content about cuda runtime env into individual posts, ensuring both the thematic integrity and a balanced size for each blog entry.

AI Hardware & Accelerators

导言

- 牧本定律由1987年牧村次夫提出,半导体产品的发展历程总是在“标准化”和“定制化”之间交替摆动,大概每十年摆动一次,揭示了半导体产品性能功耗和开发效率之间的平衡,这对于处理器来说,就是专用结构和通用结构之间的平衡—专用结构性能功耗优先,通用结构开发效率优先。

- 贝尔定律是由戈登贝尔在1972年提出的一个观察,即每隔10年,会出现新一代计算机(新编程平台、新网络连接、新用户接口、新使用方式),形成新的产业,贝尔定律指明了未来一个新的发展趋势,这将会是一个处理器需求再度爆发的时代,不同的领域、不同行业对芯片需求会有所不同,比如集成不同的传感器、不同的加速器等等。

生产特殊的硬件:

- 带来的加速比和能耗收益,达到10倍百倍都是很正常的。

- 但是开发成本也是巨大的,包括芯片设计,流片成本,软件栈的开发,商业化的推广。

- 开发周期也相当长。需要对当前的技术的未来具有前瞻性。不要生产出来就过时了。

常见的例子,用于并行计算的GPU, H265视频编解码单元, Google TPU芯片、车载芯片、手机AI芯片。

AI领域的至今不变的特点:

- 基于反向传播和梯度/参数更新的整体逻辑

- 需要保存大量的参数来表征问题,以高维矩阵的形式存储,所以矩阵运算十分常见

- 训练由于要计算并更新梯度,一般是计算密集。但是推理一般是访存密集。

现在大火的transformer,除非它就是AGI的最理想模型,不然为一个模型专门定制硬件,很容易钱就打水漂了。为自己的算法模型定制一块AI芯片,如特斯拉。但应用面越窄,出货量就越低,摊在每颗芯片上的成本就越高,这反过来推高芯片价格,高价格进一步缩窄了市场,因此独立的AI芯片必须考虑尽可能适配多种算法模型。1

当然,也可以从workload的应用出发,分析有什么重复的热点,值得做成专用的电路单元。

Ideas around T2I2V models

导言

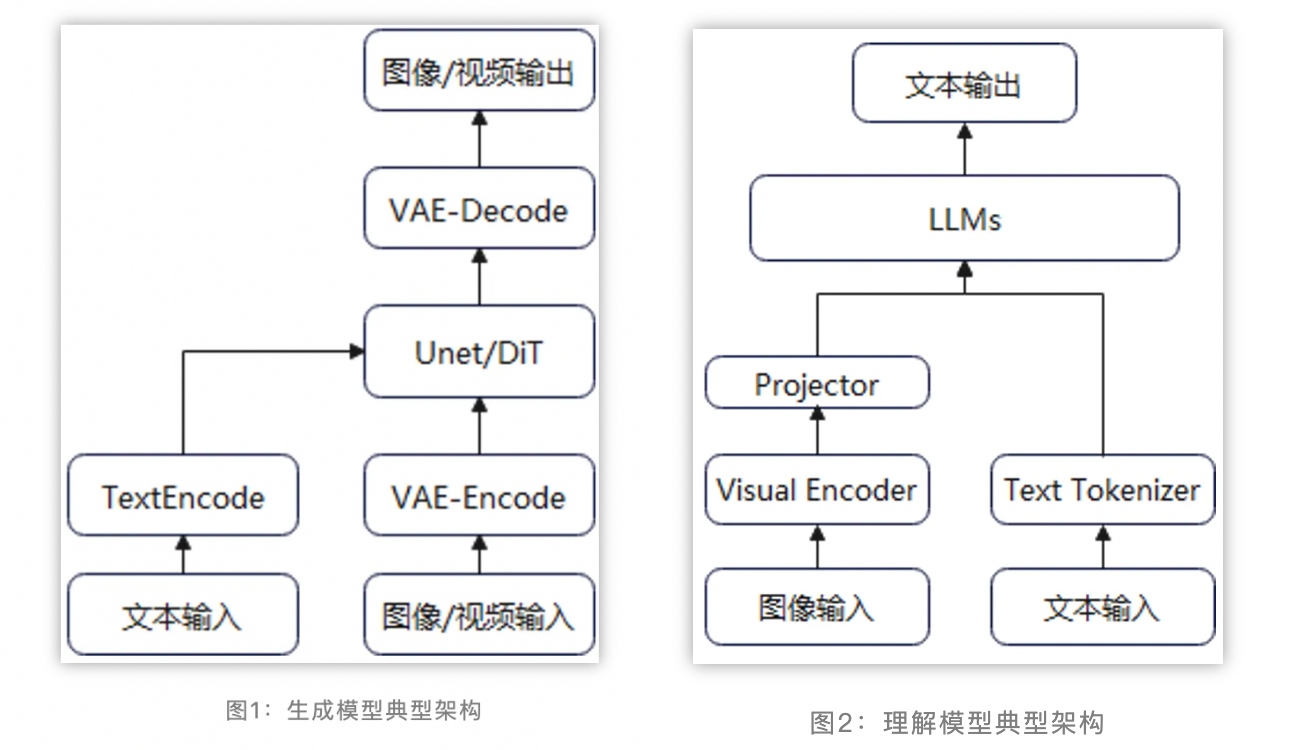

当前主流的多模态生成模型(如图像生成text2image和视频生成text2video)主要采用Latent Stable Diffusion的方案框架。为了减少计算量,图像/视频等模态的数据(噪声)先经过VAE压缩得到Latent Vector,然后在文本信息的指导下进行去噪,最后生成符合预期的图像或视频。

排行榜: (T2I, ImageEdit, T2V, I2V, )

- Vbench

- lmarena

-

当前主流的多模态生成模型(如图像生成和视频生成)主要采用Latent Stable Diffusion的方案框架。为了减少计算量,图像/视频等模态的数据(噪声)先经过VAE压缩得到Latent Vector,然后在文本信息的指导下进行去噪,最后生成符合预期的图像或视频。

- 当前主流的多模态理解模型一般采用视觉编码器 + 模态对齐 + LLM的算法流程,充分复用已有视觉编码器的理解能力和LLM的基础能力。训练过程一般分为多个阶段,如先进行模态对齐的一阶段预训练,然后进行二阶段的参数微调。

Understand deeper : Why xxx is useful?

导言

明白设计(数据构造,模型设计, 训练流程)的有效性,是抓住问题核心的关键。有助于在众多的AI论文里筛选出有效结论。

- 一些AI大厂只是通过不断的微调,消融尝试,堆砌最新的trick方法达到SOTA,再提出一些听上去make sense的观点来发论文。但是其观点的可迁移性难以保障。

- 但是一些研究人员专注在AI的有效性,可解释性的探索:虽然难有直接产出,但是对AI技术的未来方向提供了宝贵的信息。(e.g., 研究模型参数和层的有效性,流程的必要性)

通过这些宝贵的信息,才能渐渐知道能被时间检验过的经验是什么。

本文将聚焦于归档 有效性相关的工作。

Deploy Stable Diffusion to A100

导言

- 图片推理多采用各种GUI(ComfyUI, Stable Diffusion WebUI) 2

- 训练基于 kohya-trainer 和 GUI, 带标签的二次元图片数据可以从 danbooru 爬取。

- 模型和方法实现,如LyCORIS框架? 从civitai免费下载

Inference Basic

导言

RL 涉及到 推理,推理的流程细节不是很明晰。

- warmup,计算kvcache

- chunked prefill,降低prefill的显存